ChatGPT versteht natürliche Sprache. Claude schreibt Code. Generische KI-Agenten aus Marktplätzen versprechen, jede Aufgabe zu lösen. Da liegt ein Gedanke nahe: Warum nicht einfach ein LLM an den Produktkatalog anbinden und die Shop-Suche damit ersetzen?

Der Gedanke ist nachvollziehbar. Er ist auch gefährlich.

Nicht weil generische KI schlecht wäre. Sondern weil "Suche" im E-Commerce etwas völlig anderes bedeutet als "eine Frage beantworten". Wer einen Prototyp mit einer LLM-API baut, hat nach einer Woche ein beeindruckendes Demo. Wer damit in den Live-Betrieb geht, hat nach einem Monat ein Problem.

Dieser Artikel erklärt, warum spezialisierte AI-Infrastruktur existiert, was sie von generischen KI-Tools unterscheidet und warum die smartesten E-Commerce-Unternehmen beides kombinieren statt sich für eines zu entscheiden.

Der Prototyp-Trugschluss: Warum die Demo lügt

Ein LLM kann Ihren Produktkatalog als Kontext verarbeiten und Suchanfragen in natürlicher Sprache beantworten. Das funktioniert in der Demo mit 50 Produkten einwandfrei. In der Realität eines Online-Shops mit 10.000 oder 50.000 SKUs beginnen die Probleme, die in keiner Demo sichtbar sind.

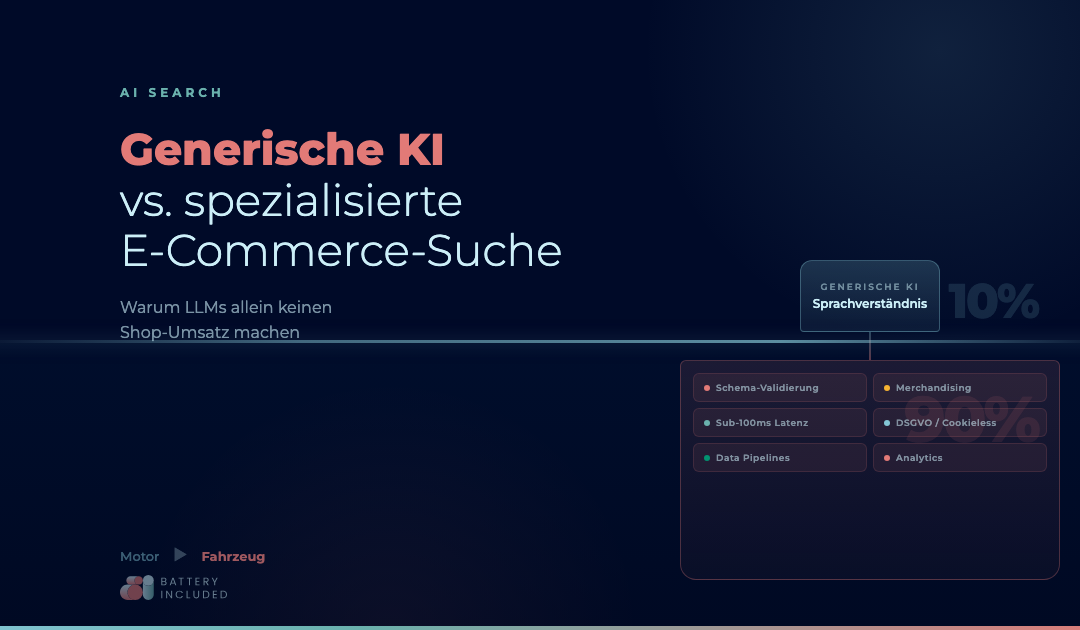

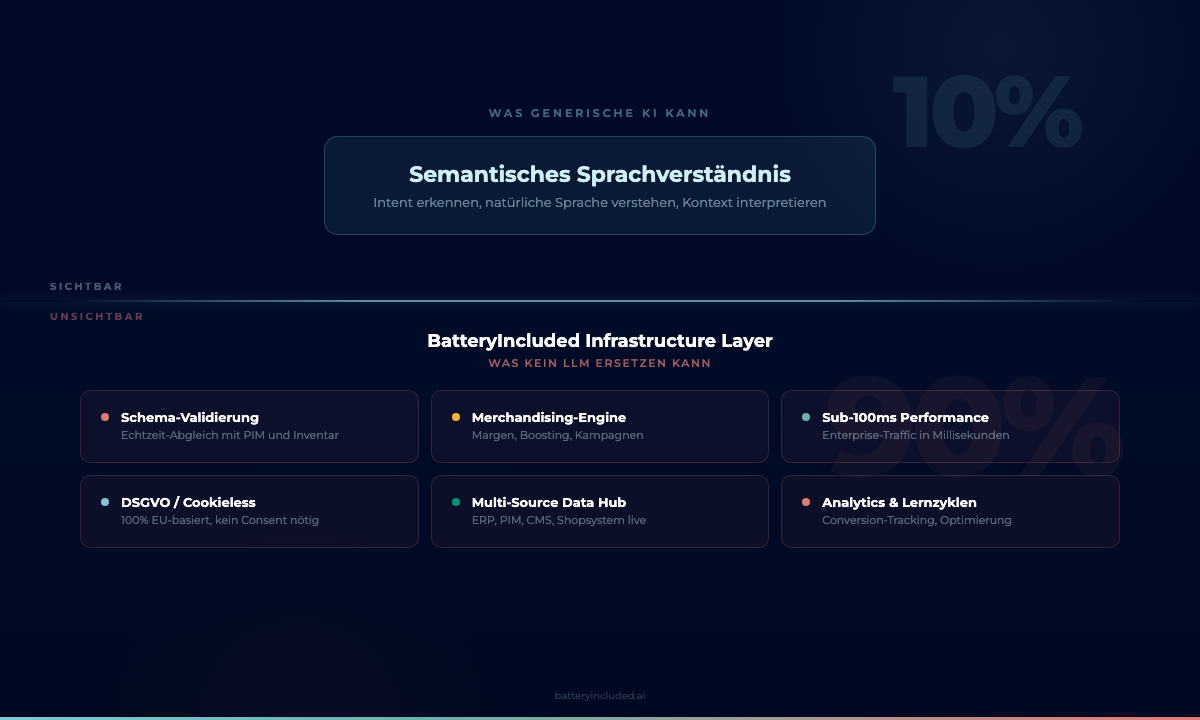

Das Eisberg-Prinzip der E-Commerce-Suche

Die sprachliche Intelligenz eines LLMs ist die sichtbare Spitze. Etwa 10 % dessen, was eine produktionsreife Shop-Suche ausmacht. Die restlichen 90 % liegen unter der Oberfläche:

-

Schema-Validierung: Jedes Suchergebnis muss gegen Echtzeit-Inventar, Preise, Verfügbarkeit und Produktattribute validiert werden. Ein LLM weiß nicht, dass Größe 43 ausverkauft ist.

-

Merchandising-Logik: Welche Produkte sollen oben stehen? Eigenmarken pushen, Abverkaufsware priorisieren, saisonale Kampagnen steuern. Kein LLM trifft diese betriebswirtschaftlichen Entscheidungen.

-

Filtersysteme: Dynamische Facetten, die sich je nach Suchanfrage intelligent anpassen. Wer "Laptop" sucht, braucht Filter für RAM und Prozessor, nicht für Farbe.

-

Analytics und Lernzyklen: Welche Suchen führen zu Käufen? Wo brechen Nutzer ab? Welche Begriffe produzieren keine Ergebnisse? Ohne diese Daten optimieren Sie blind.

-

Performance-Infrastruktur: Sub-100-Millisekunden-Antwortzeiten bei Tausenden gleichzeitigen Anfragen. Jede zusätzliche Sekunde Ladezeit kostet messbar Conversion.

-

Daten-Pipelines: Echtzeit-Synchronisation mit ERP, PIM, CMS und Shopsystem. Preisänderungen, Bestandsupdates, neue Produkte. Ohne Verzögerung.

All das baut niemand nebenbei. Das ist Infrastruktur, die über Jahre entsteht.

Fünf Gründe, warum generische KI-Tools im Live-Shop scheitern

1. Halluzinationen treffen auf harte Kaufentscheidungen

Generische LLMs sind Textgeneratoren. Ihr Ziel ist eine sprachlich plausible Antwort. Im E-Commerce ist "plausibel" nicht genug. Hier zählt nur "korrekt".

Ein Beispiel: Ein Kunde sucht nach "blaue Laufschuhe von Nike, Größe 43, unter 50 Euro". Findet das LLM kein exaktes Match, wird es kreativ. Es empfiehlt Produkte, die nicht auf Lager sind. Es ignoriert den Maximalpreis. Es erfindet Varianten, die nicht existieren.

Was im Chatbot als charmant durchgeht, ist im Shop ein Conversion-Killer. Ein Kunde, der ein Produkt in den Warenkorb legt und an der Kasse erfährt, dass es nicht verfügbar ist, kommt nicht wieder.

Spezialisierte AI-Infrastruktur löst das durch einen strikten Validierungs-Layer. Hybrid LLM Search versteht die Anfrage semantisch genauso gut wie ein generisches LLM. Aber jedes Ergebnis wird in Millisekunden gegen PIM-Daten und Live-Inventar abgeglichen. Es wird ausschließlich ausgespielt, was tatsächlich kaufbar ist.

2. Kein Geschäftssinn: Das Merchandising-Defizit

Einem LLM ist egal, ob Produkt A eine Marge von 40 % hat und Produkt B ein Ladenhüter ist. Die API sortiert nach semantischer Nähe zur Anfrage. Punkt.

E-Commerce ist strategisches Merchandising. Die Suche ist kein neutraler Informationskanal. Sie ist ein Vertriebsinstrument. Eigenmarken pushen, saisonale Aktionen steuern, Abverkaufsware priorisieren, Suchergebnisse profitabilitätsgesteuert ausliefern. Das sind Anforderungen, die jeder E-Commerce-Manager täglich hat.

Eine spezialisierte Engine verbindet sprachliche Intelligenz mit den wirtschaftlichen Zielen des Unternehmens. Durch definierte Regeln, dynamisches Boosting und automatisierte Kampagnenlogik ordnet sich die KI den Abverkaufszielen unter. Nicht umgekehrt.

3. Latenz killt Conversion

Jede Suchanfrage live an eine externe LLM-API zu senden, kostet Zeit. Generische APIs antworten im Bereich von Sekunden, nicht Millisekunden. Für einen Chatbot ist das akzeptabel. Für eine Typeahead-Suche, die bei jedem Tastendruck Vorschläge liefern soll, ist es disqualifizierend.

Die Zahlen sind eindeutig: Bei Ladezeiten über einer Sekunde sinkt die Conversion Rate messbar. Bei zwei Sekunden verlieren Sie Kunden. Bei drei Sekunden haben Sie ein ernstes Problem.

Spezialisierte Infrastruktur ist auf Millisekunden-Performance optimiert. Entkoppelt vom Shopsystem, mit eigenem Daten-Hub, auf Enterprise-Traffic-Volumen skaliert. Kein externer API-Call, der den gesamten Suchprozess ausbremst.

4. DSGVO: Der europäische Elefant im Raum

Jede Suchanfrage eines Nutzers an ein US-basiertes LLM zu senden, erzeugt einen personenbezogenen Datentransfer in ein Drittland. Das erfordert nach aktueller DSGVO-Rechtsprechung eine explizite Einwilligung. Bei jedem Tastendruck.

Das bedeutet in der Praxis: Sie brauchen ein Cookie-Consent-Banner, das Ihre Suche erst nach Zustimmung aktiviert. Zwischen 40 und 60 % der Nutzer lehnen Tracking ab. Für diese Kunden funktioniert Ihre Suche dann gar nicht oder nur in einer reduzierten Version.

Eine EU-basierte, cookieless Lösung umgeht dieses Problem vollständig. Keine Nutzerdaten verlassen die EU. Kein Consent notwendig. Die Suche funktioniert für 100 % der Besucher, nicht nur für die Hälfte.

5. Das "Day 2"-Problem: Vom Prototyp zur Produktion

Die größte Falle ist nicht der Bau eines Prototyps. Die größte Falle ist Tag 2.

Ein Prototyp mit einer LLM-API steht in einer Woche. Er beeindruckt im Boardroom. Dann beginnt die echte Arbeit:

-

Wie synchronisieren Sie Preisänderungen in Echtzeit?

-

Wie reagieren Sie, wenn 500 Kunden gleichzeitig suchen und die API-Rate-Limits greifen?

-

Wer pflegt die Synonymlisten, wenn die KI "Jogginganzug" nicht mit "Trainingsanzug" verbindet?

-

Wer baut das Analytics-Dashboard, das zeigt, welche Suchen nicht konvertieren?

-

Wer überwacht die Kosten, wenn jede Anfrage Token verbraucht und Ihre Suchvolumen im Black Friday um 500 % steigen?

-

Wer stellt sicher, dass das System bei einem API-Ausfall des LLM-Anbieters nicht komplett ausfällt?

Für jede dieser Fragen brauchen Sie Entwickler. Permanent. Nach einer konservativen Schätzung bindet der Eigenbau einer produktionsreifen, KI-gestützten Shop-Suche zwei bis drei Vollzeit-Engineers. Dauerhaft. Die jährlichen Personalkosten übersteigen die Investition in eine spezialisierte Lösung um ein Vielfaches.

Der eigentliche Punkt: Es ist nicht KI vs. keine KI

Hier liegt das fundamentale Missverständnis. Spezialisierte E-Commerce-Suchinfrastruktur ist keine Alternative zu KI. Sie baut auf KI auf.

Hybrid LLM Search nutzt dieselben Sprachmodelle und semantischen Technologien wie generische KI-Tools. Der Unterschied: Diese Fähigkeiten sind eingebettet in eine Infrastruktur, die für den E-Commerce gebaut wurde. Mit Schema-Validierung, Merchandising-Engine, Performance-Optimierung, DSGVO-Konformität und Multi-Source-Datenaggregation.

Es ist der Unterschied zwischen einem Motor und einem Fahrzeug. Ein Motor ist beeindruckend. Aber um von A nach B zu kommen, brauchen Sie ein Fahrwerk, Bremsen, Lenkung, Navigation. Der Motor allein bringt Sie nirgendwohin.

Generische KI ist der Motor. Spezialisierte Infrastruktur ist das Fahrzeug.

Was passiert, wenn Unternehmen es trotzdem selbst bauen

Die Erfahrung zeigt ein wiederkehrendes Muster. Unternehmen, die den Eigenbau starten, durchlaufen drei Phasen:

Phase 1 (Woche 1-4): Begeisterung. Der Prototyp steht. Die Demo funktioniert. Das Board ist überzeugt. "Sieht doch aus, als bräuchten wir dafür keinen externen Anbieter."

Phase 2 (Monat 2-6): Ernüchterung. Edge Cases häufen sich. Die Suche halluziniert bei bestimmten Produktkategorien. Performance-Probleme bei Lastspitzen. Das Analytics-Team vermisst Daten. Der Pflegeaufwand wächst. Ein Entwickler arbeitet mittlerweile fast ausschließlich an der Suche.

Phase 3 (Monat 6-12): Entscheidung. Die TCO-Rechnung ergibt, dass der Eigenbau teurer ist als die spezialisierte Lösung. Das Unternehmen evaluiert erneut. Diesmal mit einem realistischen Anforderungskatalog.

Praxis-Ergebnis: Was spezialisierte Infrastruktur liefert

"Bereits nach zwei Monaten stieg unsere Conversion Rate um 10 Prozent, und nach vier Monaten konnten wir einen Zuwachs von 19 Prozent verzeichnen. Die Wirkung ist nicht nur schnell spürbar, sondern zeigt auch über die Zeit kontinuierlich positive Ergebnisse für unser Business."

B&W Handelsgesellschaft mbH

"BatteryIncluded.ai ist genau das, was man sich von moderner E-Commerce-Technologie wünscht: blitzschnelle Suche auch bei über 50.000 Produkten, volle Anpassbarkeit für komplexe Anforderungen und ein Support, der nicht nur reagiert, sondern wirklich versteht. Stabil, skalierbar, zukunftssicher."

Österreichischer Bundesverlag Schulbuch GmbH & Co. KG

Diese Ergebnisse entstehen nicht durch ein LLM allein. Sie entstehen durch die Kombination aus semantischem Verständnis und einer Infrastruktur, die über Jahre für genau diese Aufgabe optimiert wurde.

Entscheidungshilfe: Wann generische KI reicht und wann nicht

|

Kriterium |

Generische KI-Tools können ausreichen |

Spezialisierte Infrastruktur notwendig |

|---|---|---|

|

Kataloggröße |

< 100 Produkte, statisches Sortiment |

> 1.000 SKUs, dynamisches Inventar |

|

Traffic |

Wenige hundert Suchen pro Tag |

Tausende gleichzeitige Anfragen |

|

Merchandising |

Keine strategische Sortimentssteuerung nötig |

Margen, Kampagnen, Abverkauf relevant |

|

Compliance |

Kein EU-Geschäft oder B2B ohne Endverbraucher |

B2C in der EU, DSGVO-Pflichten |

|

Performance |

Antwortzeit unter 3 Sekunden akzeptabel |

Sub-100ms für Typeahead und Live-Suche |

|

Wartung |

Eigenes Dev-Team mit Kapazität für permanente Pflege |

Keine internen Ressourcen für Suchinfrastruktur |

Fazit: Die Frage ist nicht "KI ja oder nein"

Generische KI-Modelle setzen neue Standards dafür, wie Nutzer suchen wollen. Kontextbasiert, in natürlicher Sprache, mit echtem Verständnis für Intention. Diese Entwicklung ist nicht aufzuhalten und sie ist gut.

Aber ein LLM ist kein Suchprodukt. Es ist eine Fähigkeit. Die Frage für Shopbetreiber ist nicht, ob sie KI einsetzen. Die Frage ist, ob sie diese Fähigkeit roh und ungebunden in ihren Shop werfen. Oder ob sie auf eine Infrastruktur setzen, die semantisches Verständnis mit Geschäftslogik, Performance, Datenschutz und kontinuierlicher Optimierung verbindet.

Die Antwort liegt in der Spezialisierung.

Lesen Sie auch: